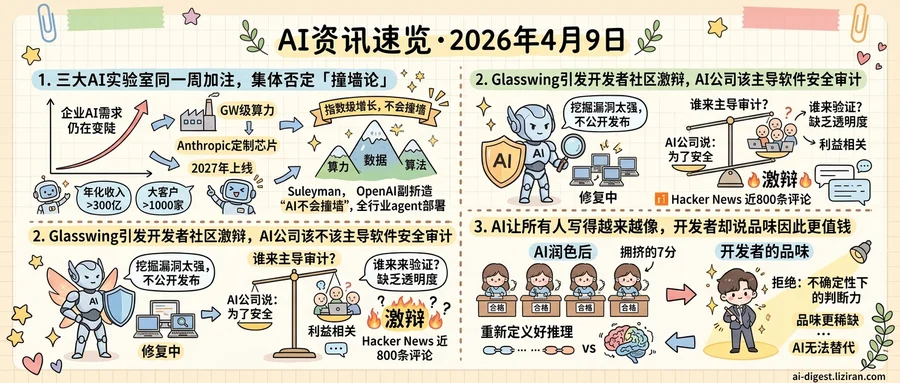

01三大AI实验室同一周加注,集体否定「撞墙论」

Anthropic的年化收入半年内从不到90亿美元涨到300亿,年消费超百万美元的企业客户突破1000家,两个月翻了一倍。这种加速度解释了它本周签下GW级算力协议的逻辑:与博通合作设计定制芯片,在谷歌云上部署,产能预计2027年上线。

选择定制芯片而非直接采购GPU,说明Anthropic预期的不是稳态增长,而是需要为两年后的需求提前锁定专属产能。这不只是一家公司的判断。OpenAI同一周发布了企业AI「下一阶段」路线图,把agent和自动化工具推向全行业部署。一个锁产能,一个扩入口,押的是同一个方向:企业AI需求的曲线仍在变陡。

微软AI负责人Suleyman把这个判断直接写成了文章标题。他本周在《麻省理工科技评论》发文论证AI不会撞墙,核心论据是人类的线性直觉无法理解指数级增长,而算力、数据和算法三条曲线仍在陡峭上升期。过去半年,「scaling law是否失效」的讨论在研究社区持续发酵,他选择在这个节点公开反驳,本身就是一种表态。

三条消息从基础设施、商业化和叙事三个方向否定了同一个假说。Anthropic用300亿美元年化收入和翻倍的客户增速回应了市场。OpenAI把企业级agent推向了全行业。Suleyman公开论证增长不会放缓。六个月前还被认真对待的平台期假说,这一周面对的是一笔要到2027年才上线的GW级定制芯片订单。

02Glasswing引发开发者社区激辩,AI公司该不该主导软件安全审计

Anthropic称最新模型挖掘漏洞的能力太强,不能公开发布。开发者社区对这个说法的第一反应不是惊叹,而是追问:你说自己太强,谁来验证?

该模型在预览阶段已发现数千个高危漏洞,目前通过Glasswing项目仅向少数安全研究者开放。消息在Hacker News上引发近800条评论(安全话题中极罕见的规模),焦点落在一个问题:AI公司有没有资格主导关键软件的安全审计?

知名开发者Simon Willison在博文中称这套做法「听起来是必要的」,能批量挖掘高危漏洞的模型确实不该随便放出来。但他的支持带着保留:信任建立在透明度上,不是公司的单方面声明上。

反对者的逻辑也清晰:一家卖AI的公司用自己的模型发现漏洞,再用漏洞证明自家产品需要特殊管控,每一步都是利益相关方在自证。社区对「太强所以需要限制」这套叙事天然警惕。

目前合作伙伴正在修复已发现的漏洞,但修复了多少、何时向公众披露,Anthropic尚未说明。

03AI让所有人写得越来越像,开发者却说品味因此更值钱

用ChatGPT润色过的文章更通顺了,但风格上越来越像别人写的。南加州大学研究团队在认知科学期刊发表论文,发现大语言模型的输出比人类写作多样性更低,偏向西方高教育群体的语言和推理习惯。单个用户借助大语言模型能产出更多想法,但一群人都在用时,群体创意总量反而下降。

同一周,开发者Sharma的一篇博客在技术社区广泛传播,给出完全相反的解读。他认为AI让合格输出变得廉价,世界滑向「拥挤的7分」,最稀缺的能力从生成变成了拒绝:对没有辨识度的结果说不。品味,在他的定义里是「不确定性下的判断力」,恰恰是AI无法替代的。

但这篇论文发现,大语言模型不只改变人怎么写,还在重新定义什么算「好的推理」——模型偏好线性链式推理,抑制直觉和抽象思考。第一作者Sourati的表述很直接:大语言模型正在「重新定义什么算正确的观点」。

OpenAI发布儿童安全蓝图 OpenAI公开了一份面向AI开发者的儿童安全指南,涵盖安全护栏设计、年龄适配交互和跨机构协作机制,为构建面向未成年人的AI产品提供参考框架。 openai.com

Claw-Eval:300道人工验证任务,专测agent安全与鲁棒性 现有agent基准只看最终输出、忽略执行轨迹,安全评估近乎空白。Claw-Eval针对这三个盲区设计了端到端评估套件,覆盖多模态交互和多步骤工作流,含300道经人工校验的任务。 huggingface.co

检索系统开始为agent而非人类优化 传统信息检索依赖点击率和停留时间等人类行为信号训练排序模型。新研究提出直接从agent的多轮推理轨迹中学习检索偏好,适配agent作为检索消费者的场景。 huggingface.co

ThinkTwice:两阶段训练让LLM学会自我修正 ThinkTwice在每一轮训练中先让模型解题、再让模型修正自己的答案,两阶段共享同一个二元正确性奖励,无需额外标注。在五个数学推理基准上均有提升。 huggingface.co

GBQA用30款游戏的124个bug测试LLM能否做QA工程师 研究者构建了一个游戏质量保证基准,包含三个难度等级的真实bug,评估LLM在动态运行时环境中自主发现缺陷的能力。结果显示,相比代码生成,bug发现对LLM仍是显著更难的任务。 huggingface.co

Memory Intelligence Agent:让深度研究agent的记忆能自我进化 现有agent记忆方案靠检索相似历史轨迹辅助推理,但记忆本身不会更新,存储和检索成本持续膨胀。MIA框架让agent的记忆可压缩、可演化,降低冗余的同时提升推理效率。 huggingface.co

Video-MME-v2:视频理解基准分数虚高,新版用三级递进结构重测 现有视频理解排行榜趋于饱和,分数与实际能力脱节。Video-MME-v2设计了递进式三层评估结构,系统检验模型的鲁棒性和忠实度。 huggingface.co

ACES:用排序代替计票,解决LLM生成测试自身不可靠的问题 用LLM生成的测试筛选LLM生成的代码,测试本身可能有错,形成循环依赖。ACES的核心思路是不判断测试对错,而是用留一法AUC对测试投票做排序,在多个代码生成基准上提升了选择准确率。 huggingface.co