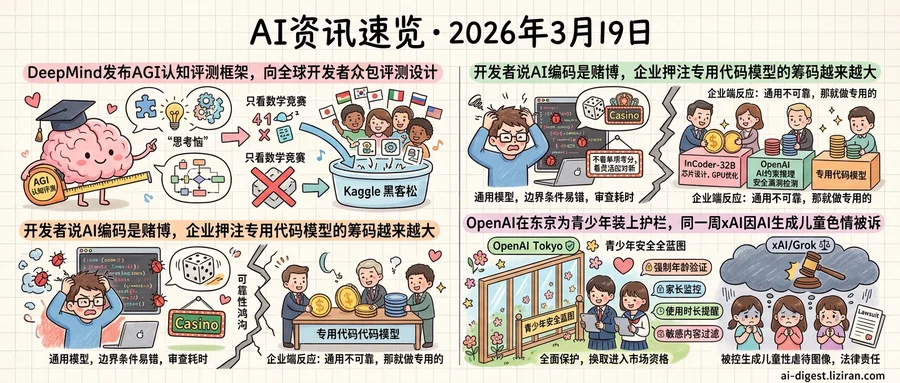

01DeepMind发布AGI认知评测框架,向全球开发者众包评测设计

每家头部AI公司都说自己「接近AGI」,但没人拿得出一套公认的衡量标准。有人看数学竞赛成绩,有人看编程能力,定义完全各说各话。DeepMind本周给出了不同的回答:与其争论谁更接近,不如先定义「接近」怎么量。它发布了一套认知评测框架,配套的黑客松同步在Kaggle上线,邀请全球开发者参与设计具体的评测任务。

这套框架不看单项考分,评估的是AI面对从未见过的任务时能否灵活应对。DeepMind定了衡量维度的底层逻辑,具体的评测方案由社区来填。被采纳的方案将直接纳入其正式评测体系。

如果标准完全由一家公司制定,行业很难买账。让外部开发者介入评测设计,框架从起点就多了一层独立性。而在各家公司各自定义进步的局面下,谁先立起一套被广泛接受的评测体系,谁的尺子就成了行业的尺子。

「测量AI认知」正从哲学辩论变成工程实践。同期一篇论文提出用强化学习训练AI的「科学品味」,让模型学会判断哪些研究想法值得追。这种元认知能力的量化两年前还是纯思辨话题,如今已有具体的训练范式。DeepMind的黑客松则在对更基础的通用认知做同样的事。

Kaggle黑客松已开放报名。

02开发者说AI编码是赌博,企业押注专用代码模型的筹码越来越大

一篇题为「AI编码是赌博」的博文在Hacker News引来381条评论,开发者的不满很具体:AI写的代码看似能跑,但边界条件下随时出错,逐行审查的成本经常吃掉了自动生成省下的时间。问题不在技能,在信任。

企业端的反应恰恰相反。InCoder-32B刚刚发布,320亿参数专为芯片设计、GPU内核优化和嵌入式场景训练,是首个明确面向工业代码的基础模型。背后的逻辑是:通用模型不可靠,那就做专用的。

OpenAI的做法更激进。Codex Security直接抛弃传统静态分析,转用AI约束推理检测漏洞,理由是老工具误报太多。不是在旧流程上叠一层AI,而是整套检测方法从头来过。

三个信号拼在一起,裂缝的轮廓很清楚:开发者在一线踩刹车,企业在产品层踩油门,两边回应的是同一个可靠性问题,给出的答案截然相反。InCoder-32B的论文坦承,通用模型在工业场景「性能显著下降」,而它声称专用训练能弥补这个差距。

03OpenAI在东京为青少年装上护栏,同一周xAI因AI生成儿童色情被诉

OpenAI Japan本周发布「青少年安全蓝图」,针对日本市场推出一整套未成年人保护机制:强制年龄验证、家长监控面板、使用时长提醒,以及敏感内容的多层过滤。日本对青少年网络安全的监管向来严格,OpenAI选择在这个市场率先落地完整保护方案,用开发成本和产品限制换取进入学校和家庭场景的资格。

同一周,xAI在美国被三名未成年女孩的家庭起诉。她们指控Grok将真实照片生成了儿童性虐待图像,案件已进入司法程序。

同一个行业,截然不同的安全策略。OpenAI把青少年保护做成打开日本市场的前置投资,蓝图覆盖从注册到日常使用的全流程:未成年用户通过年龄验证后才能使用服务,家长可以查看对话摘要并设置使用时间和内容边界。

Mistral发布agent开发平台Forge Mistral上线Forge,为开发者提供构建和部署AI agent的集成平台。 mistral.ai

研究者提出Attention Residuals,用注意力机制替代LLM中的固定残差连接 现有LLM的残差连接以固定权重累加各层输出,导致隐藏状态随深度膨胀、单层贡献被稀释。Attention Residuals(AttnRes)改用softmax注意力对前序层输出做可学习的加权聚合,允许每层根据输入动态选择聚合哪些早期表示。 huggingface.co

千帆OCR发布:40亿参数端到端文档智能模型 Qianfan-OCR将文档解析、版面分析和文档理解统一到单一架构中,直接完成图像到Markdown的转换,支持表格提取、图表理解、文档问答等多种提示驱动任务。团队同时提出Layout-as-Thought机制,在端到端OCR中恢复显式版面分析能力。 huggingface.co

新框架让语言模型从真实部署经验中持续学习 研究者提出Online Experiential Learning(OEL),分两阶段运作:先从交互轨迹中提取可迁移的经验知识并累积存储,再用这些经验在线更新模型。该方法利用了当前完全被浪费的真实部署数据。 huggingface.co

视频扩散模型的推理能力来自去噪步骤,而非逐帧推理 此前研究认为视频模型通过Chain-of-Frames机制沿帧序列展开推理。新研究否定了这一假设,发现推理主要沿扩散去噪步骤展开,而非沿帧方向。 huggingface.co

MiroThinker-1.7发布,面向复杂长程推理任务的研究agent MiroThinker-1.7通过agentic中训练阶段强化结构化规划、上下文推理和工具交互,提升每步交互的可靠性。进一步推出的MiroThinker-H1扩展了重型推理能力,增加验证机制以支持多步问题求解。 huggingface.co

TRUST-SQL:在未知数据库schema下完成Text-to-SQL 现有Text-to-SQL系统依赖完整schema输入,但企业环境中数据库常有数百张表和大量噪声元数据。TRUST-SQL让agent主动探索并验证相关schema子集,而非一次性注入全部schema,并通过多轮强化学习训练工具交互能力。 huggingface.co

WorldCam用相机位姿作统一几何表示,生成可交互的3D游戏世界 现有交互式游戏世界模型将用户动作当作抽象条件信号,忽略动作与3D世界之间的几何耦合。WorldCam将相机位姿作为统一表示,将用户动作直接映射为相机运动,解决精确动作控制和长程3D一致性问题。 huggingface.co

FinToolBench:首个评估LLM agent金融工具使用能力的基准 金融领域的LLM评估长期停留在静态文本分析和文档问答层面。FinToolBench针对金融场景的高风险、合规要求和数据时效性特点,评估agent在真实金融工具交互中的复杂推理和多步操作能力。 huggingface.co

用隐空间熵感知解码缓解多模态推理模型的幻觉 研究发现多模态推理模型中的转折词(如because、however、wait)与幻觉高度相关,且倾向于出现在高熵状态。基于叠加表示理论,研究者提出从token概率分布中直接提取上下文推理信息,在解码阶段介入以减少幻觉生成。 huggingface.co