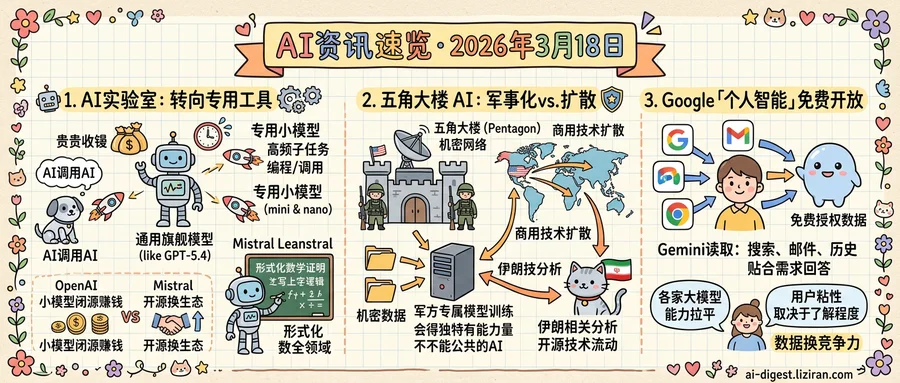

01AI实验室不再比「最强」,OpenAI和Mistral同时押注专用工具型模型

GPT-5.4旗舰版发布不到一周,又出了mini和nano两个小版本。但这两个模型不是廉价替代品,从一开始就不是给人用的。

发布公告反复强调的关键词是sub-agent workloads。mini和nano针对编程、工具调用和多模态推理优化,核心场景是高频子代理任务。它们的「用户」是其他AI:当agent系统同时调度几十个子任务时,旗舰模型太贵太慢,专用轻量模型才是合理选择。

同一周,Mistral走了一条完全不同的路。它开源的Leanstral只做一件事:用Lean语言写形式化数学证明。这不是通用coding助手,方向窄到大多数开发者永远用不上。但对数学和安全关键领域的研究者来说,通用模型在形式化推理上远远不够,专用工具才能补这个缺。

两个发布来自不同实验室、面向不同场景,背后的判断却一致:通用旗舰模型的边际收益在递减,专用工具才是下一个价值高地。OpenAI做横向专用化,让小模型服务于agent生态的高频调用;Mistral做纵向专用化,在极窄领域做到通用模型做不到的深度。

竞争策略也因此分化。OpenAI的小模型是闭源产品,靠调用量赚钱;Mistral选择完全开源。旗舰模型阶段,开源意味着拱手让出最贵的资产,但专用工具阶段,开源一个窄领域agent的成本远低于开源通用大模型,换来的生态卡位却可能同样有效。项目开源后在Hacker News拿到735票,对一个数学证明工具来说极为少见。

02五角大楼要用机密数据训练AI,但同一技术可能已在流向伊朗

一批永远不能公开审计、不能独立做安全测试的AI模型,正在美国国防部的计划中成形。据MIT Technology Review报道,五角大楼正与AI公司讨论在安全设施内用机密数据训练军方专属模型。这不是采购商用AI来部署,而是把训练管道本身军事化。

Claude目前已在机密网络上运行,用于分析伊朗相关目标,但仅限推理层——模型回答问题,并不从机密数据中学习。五角大楼下一步要打通的是训练层:让模型直接吸收机密情报,生成商用版本不具备的专属能力。

但同一周,该媒体另一篇报道追踪到,OpenAI的商用技术正通过多条路径流入伊朗。最前沿的AI能力一旦变成产品进入市场,扩散就超出了出口管制能覆盖的范围。

美国政府想在密室中精确控制AI的训练数据和输出,却连商用AI产品的跨境流向都拦不住。训练管道的军事化计划目前仍在讨论阶段,而技术扩散已经在发生。

03Google免费开放「个人智能」,拿用户数据换AI竞争力

Google在大模型竞赛中一直扮演追赶者,但本周二换了个打法。它把「个人智能」功能免费开放给全美用户,让Gemini直接读取搜索记录、邮件和浏览历史来回答问题。此前这项功能只有付费订阅者才能用。

Google这么做有底气。它同时运营着全球最大的搜索引擎、用户最多的邮箱和份额最高的浏览器,没有第二家AI公司有这个数据组合。这些数据拼在一起,Gemini就能知道你在查什么航班、收件箱里躺着什么合同,给出的回答天然比通用模型更贴合需求。

这也解释了为什么选择免费。当各家大模型能力逐渐拉平,用户粘性取决于谁更了解面前这个人。付费墙挡住的每一个用户,都是一份喂不进模型的数据。

官方博客称,这项扩展覆盖搜索、Gemini应用和浏览器三个入口。用户不需要掏钱,只需授权自己的数据。

Microsoft任命新Copilot负责人,统一消费端与企业端团队 Microsoft再次调整AI高管架构,将此前分别负责消费者和企业版Copilot的团队合并,由新负责人统一管理。调整旨在解决两条产品线长期各自为战的问题。 theverge.com

OpenAI:美国用户每天向ChatGPT发送近300万条薪资相关提问 OpenAI发布研究称,大量用户使用ChatGPT查询薪酬和收入信息,正在帮助缩小劳动力市场的薪资信息差。 openai.com

Google发布AI驱动的开源安全工具 Google宣布对开源安全领域追加投资,推出新的AI安全工具和代码安全功能,覆盖漏洞检测和代码审计环节。 blog.google

OpenSeeker完整开源搜索agent训练数据,降低深度搜索开发门槛 团队发布OpenSeeker,首个完整开源搜索agent训练数据集。此前高性能搜索agent的开发因缺乏公开高质量训练数据,基本被大厂垄断。 huggingface.co

首尔世界模型:基于真实街景的城市级视频生成 研究团队发布Seoul World Model(SWM),通过检索增强调节机制,将自回归视频生成锚定在首尔的真实街景图像上,实现城市规模的世界模拟。 huggingface.co

VET-Bench测试显示当前视觉语言模型无法完成基础物体追踪 新基准VET-Bench使用外观完全相同的物体,要求模型仅凭时空连续性进行追踪。测试结果:当前最强视觉语言模型表现接近随机猜测水平。 huggingface.co

MoDA机制让attention head跨层回溯,缓解深层LLM信号衰减 研究提出Mixture-of-Depths Attention,允许每个attention head同时关注当前层的序列KV对和前序层的深度KV对,配合硬件感知设计,改善深层大模型中浅层有效特征被逐层稀释的问题。 huggingface.co

RLCF:用社区反馈训练AI的科研品味 研究提出Reinforcement Learning from Community Feedback范式,利用大规模学术社区反馈信号训练模型判断和提出高潜力研究方向,聚焦此前被忽视的科研品味能力而非执行能力。 huggingface.co

EnterpriseOps-Gym:面向企业场景的agent规划评测基准 新基准模拟企业环境中的长期规划任务,包含持续状态变更和严格权限控制,填补现有评测未覆盖真实企业复杂性的空白。 huggingface.co

向混合xLSTM架构蒸馏Transformer实现无损知识迁移 研究定义了基于容差修正胜率的「无损蒸馏」标准,将Transformer LLM蒸馏到次二次复杂度的混合xLSTM架构中,在多项下游任务上达到与教师模型持平的表现。 huggingface.co