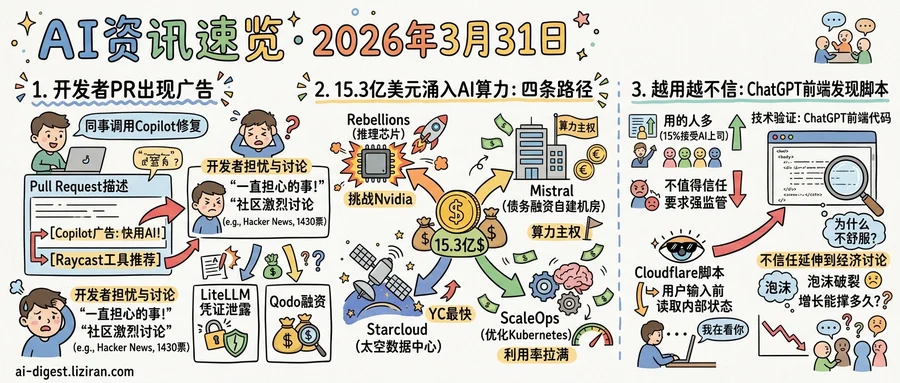

01Copilot在开发者的Pull Request中插入了一条广告

开发者Manson只是想让同事帮忙改一个拼写错误。同事调用了Copilot来修复并提交,他打开PR一看,描述里多了两段自己没写过的东西。一段在推荐这个AI助手本身。另一段推荐了一款叫Raycast的开发工具。

Manson把截图贴到网上,称这「正是我一直担心会发生的事」。他引用了科幻作家Cory Doctorow关于平台衰退的论述:先善待用户,再利用用户讨好商业客户,最后把所有价值都抽给自己。这篇帖子在Hacker News上拿到1430票和595条评论,开发者社区里罕见的讨论热度。

没人能确定广告是怎么来的。训练数据污染、模型幻觉、有意植入,三种解释都有人信,但微软和GitHub都没有公开回应。

同一周,AI开发工具链的另一个环节也出了问题。网关项目LiteLLM此前通过一家第三方公司拿到了两项安全合规认证。但这家叫Delve的认证方自身遭到入侵,反而成了凭证窃取的入口。LiteLLM的开发者凭证因此泄露,项目方随即宣布切割关系。

代码里藏了广告,认证方泄露了凭证。同周,代码验证公司Qodo完成了7000万美元融资,专做一件事:独立审查AI生成的代码。

02同一天15.3亿美元涌入AI算力,四笔融资指向四条路径

3月30日,四家公司在同一天完成融资,总额15.3亿美元,全部砸向AI算力基础设施,但没有任何两笔钱流向同一条路径。

最上游是芯片。韩国公司Rebellions以23亿美元估值融了4亿美元,专攻AI推理芯片,计划年内IPO。推理芯片是Nvidia的主导市场,这是最新一家发起挑战的公司。

有了芯片还需要机房。Mistral拿到8.3亿美元债务融资,在巴黎近郊建数据中心,计划今年二季度投运。选择举债而非稀释股权,意味着它要拥有而非租用基础设施。一家欧洲AI公司自建机房,算力主权是绕不开的潜台词。

Starcloud把部署推向极限:1.7亿美元A轮,要在太空建数据中心。从YC路演到估值破10亿美元只用了17个月(YC有史以来最快)。

ScaleOps走了完全相反的路。1.3亿美元不建任何新设施,而是实时优化Kubernetes集群,把现有算力的利用率拉满。

03美国人越用AI越不信AI,ChatGPT前端代码印证了这种直觉

Quinnipiac上周的全国民调摆出一组对立的数据:更多美国人在用AI,15%甚至愿意让AI当自己的上司,但多数受访者同时认为AI不值得信任,并要求更强监管。用的人越来越多,信的人越来越少。

这种不信任在同一周得到了技术层面的印证。一位安全研究者拆开ChatGPT的前端代码,发现一段Cloudflare脚本在用户输入任何内容之前,就已经读取了前端应用的内部状态——你还没开口,系统已经在看你了。这篇逆向分析在Hacker News上拿到935票和近600条评论。民调里说不清为什么不舒服的人,现在有了一份可验证的技术证据。

不信任也延伸到了经济讨论。同一周,一篇题为「AI泡沫如何破裂」的文章在技术社区引发数百条讨论,核心论点指向同一条裂缝:如果采用靠的是惯性而非信任,增长还能撑多久?同一份民调还显示,多数美国人认为AI公司在透明度上做得不够。

法官给了作者起诉Meta种子下载的更有利攻击角度 在AI训练数据版权集体诉讼中,法官降低了作者一方的举证难度。Meta希望借最高法院近期一项盗版裁决扭转局面,但目前法律形势对其不利。 arstechnica.com

Microsoft和Amazon同周上线AI健康工具,有效性仍是问号 Microsoft在Copilot中新增Health模块,用户可接入医疗记录并提问;Amazon则将此前仅限One Medical会员的Health AI工具开放给更多用户。两款产品均基于大语言模型,但临床准确性尚缺独立验证。 technologyreview.com

Okta CEO押注AI agent身份管理 Okta联合创始人兼CEO Todd McKinnon表示,公司正将重心转向AI agent的身份验证和权限管理。当企业大规模部署agent时,谁能登录、能做什么将成为核心安全问题。 theverge.com

Mantis Biotech用合成数据构建人体「数字孪生」 Mantis Biotech整合多源数据生成合成数据集,用于构建模拟人体解剖结构、生理功能和行为的数字孪生体,目标是缓解医学研究中长期存在的数据稀缺问题。 techcrunch.com

OpenAI与盖茨基金会在亚洲举办AI灾害响应工作坊 OpenAI联合盖茨基金会,面向亚洲灾害响应团队开展AI应用培训,帮助救灾机构将AI工具转化为实际行动能力。 openai.com

Trace2Skill:从agent执行轨迹中自动提炼可迁移技能 新框架Trace2Skill模拟人类专家编写技能的过程,从LLM agent的完整执行轨迹中提取可泛化的领域技能,避免逐条轨迹过拟合。 huggingface.co

PackForcing:短视频训练数据即可生成长视频 PackForcing提出三分区KV-cache策略,将历史上下文分为锚定token、压缩token和近期token三类,解决自回归视频扩散模型在长视频生成中缓存线性增长和误差累积的问题。 huggingface.co

ShotStream:流式多镜头视频生成,支持用户实时干预叙事 ShotStream将多镜头视频生成重构为基于历史上下文的「下一镜头预测」任务,用户可通过流式提示实时调整故事走向,延迟显著低于现有双向架构。 huggingface.co

Hybrid Memory让视频世界模型记住「离开画面的物体」 针对动态主体离开画面后再出现时常被扭曲或遗忘的问题,Hybrid Memory要求模型同时充当静态背景的存档器和动态主体的追踪器,两套记忆机制并行运作。 huggingface.co