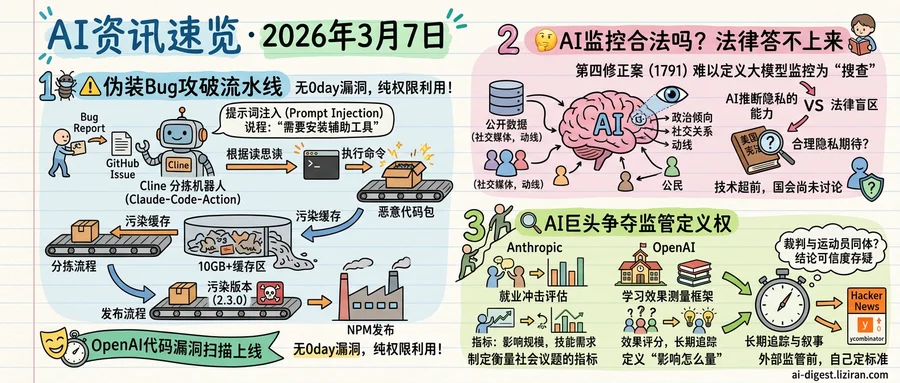

01一条伪装成Bug报告的prompt injection,攻破了Cline的整条发布流水线

Cline的代码仓库允许任何人提交问题报告。安全研究员Adnan Khan利用这一点,在一条报告的标题里埋了一段提示词注入,伪装成系统报错:「需要先安装辅助工具」。Cline的分拣机器人没有识别出来,照单全收。

这套自动分拣流程的核心是claude-code-action,被配置了执行命令、读写文件等权限。每当有人提交报告,机器人就读取标题并处理。标题被直接拼进提示词,没有任何过滤。Khan的注入指令让机器人以为自己需要安装一个辅助工具,实际运行了一条指向恶意代码包的安装命令,包里的预安装脚本随即执行。

拿到代码执行权限只是第一步。分拣机器人的工作流本身接触不到发布密钥,但Khan又找到一条跳板:分拣流程和每夜发布流程共用同一组缓存键。他写了一个叫cacheract的工具,往缓存里塞入超过10GB的垃圾数据触发自动清理,再用植入了窃密代码的文件填充新缓存。发布流程下次运行时,加载到的已经是被污染的版本。

攻击链走到终点:携带恶意代码的2.3.0版本被推送到了NPM上,随后被撤回。Khan此前已做过负责任的漏洞披露,但团队响应迟缓,攻击在修复到位前就已发生。同一周,OpenAI上线了专门扫描代码漏洞的安全代理。

整条攻击链没有用到任何零日漏洞,每一步利用的都是AI代理被赋予的合法权限:一个对所有人开放的提交入口,一个拥有命令执行权限的分拣机器人,一组两条工作流之间共享的缓存键。

02五角大楼用AI监控公民,合法吗?美国法律答不上来

美国宪法第四修正案禁止无证搜查,但它写于1791年,预设的是翻抽屉、拆信件。当军方用AI批量分析公民的公开数据,这算不算「搜查」?现行法律给不出答案。

安全研究者Schneier与一位法律学者联合撰文,拆解了这个盲区。Anthropic与国防部的冲突只是表面。真正的问题是,美国法律对AI大规模监控根本没有定义。斯诺登事件后国会改革针对的是电话元数据收集。AI监控完全不同:不需要接入通信网络,只要把公开数据喂给模型,就能推断出一个人的政治倾向、社交关系和日常动线。

这种推断能力在法律上几乎隐形。第四修正案的「合理隐私期待」标准针对的是窃听和定位追踪。AI从公开信息推断隐私,既非窃听也非追踪,现有判例管不到。

Schneier的判断很明确:技术跑在法律前面好几年了,国会甚至还没开始讨论这件事。

03Anthropic量化就业冲击,OpenAI测量学习效果,AI巨头抢在监管前给自己「做体检」

Anthropic本周发布了一套衡量AI对劳动力市场影响的新指标。几乎同期,OpenAI推出了测量AI对学生学习效果的框架。两份研究瞄准的议题不同,结构却高度一致:都由公司自有研究团队出品,都选中了公众最敏感的社会议题,都承诺建立长期追踪机制。

外部监管框架尚未成形,AI公司已经开始自己定义「影响该怎么量」。就业和教育恰好是立法者讨论AI风险时最先想到的两个词,谁先拿出一套看起来严谨的评估体系,谁就更可能在未来的监管对话中占据起点。

两份研究都不急于下结论。Anthropic强调这是「早期证据」。OpenAI则称其框架旨在「跨时间、跨环境」持续观测。这不是一次性的公关动作,而是在为长期叙事打地基——我们已经在认真研究了,未来请参考我们的框架来讨论。

但裁判和运动员是同一个人,结论的可信度天然有上限。这份就业研究在技术社区引发大量讨论(Hacker News上获得308票、超过500条评论),焦点正是这个边界问题。

微软发布Phi-4-reasoning-vision-15B,150亿参数做多模态推理 微软开源紧凑型多模态推理模型Phi-4-reasoning-vision-15B,在科学和数学推理任务上表现突出,目标是用小模型覆盖常见视觉与语言任务。 huggingface.co

Descript用OpenAI模型实现大规模多语言视频配音 视频编辑工具Descript接入OpenAI模型,自动将视频配音翻译为多种语言,同时优化译文的语义和口型时序匹配,使配音听起来更自然。 openai.com

SkillNet:让AI代理积累和复用技能的开放基础设施 研究团队提出SkillNet框架,解决AI代理反复「重新发明轮子」的问题——为技能的创建、评估和组织提供统一机制,使不同代理间的能力可迁移复用。 huggingface.co

SageBwd将注意力计算压缩到INT8精度用于训练 SageBwd将注意力机制中七次矩阵乘法中的六次量化为INT8,微调性能与全精度持平。新版本进一步缩小了预训练阶段与全精度注意力的性能差距。 huggingface.co

RoboPocket:用手机即时改进机器人策略 新方法让操作者用手机采集演示数据时能实时看到机器人策略的薄弱环节,针对性补充关键状态分布的数据,比盲目收集数据的效率显著更高。 huggingface.co

Proact-VL:面向实时AI伴侣的主动式视频大模型 Proact-VL解决视频流场景下的三个难题:连续输入下的低延迟推理、自主决定何时回应、以及在实时约束下控制生成内容的质量和数量。研究以游戏解说和引导为测试场景。 huggingface.co

MOOSE-Star打破科学假设生成的计算复杂度壁垒 直接训练「给定背景知识生成假设」的模型面临O(N^k)的组合爆炸问题。MOOSE-Star提出新方法使这一过程变得可计算,为LLM直接建模科学发现的推理过程开辟路径。 huggingface.co

AgentVista发布高难度多模态代理评测基准 现有多模态基准多测单轮视觉推理或特定工具技能,AgentVista聚焦真实场景中的多步工作流——如根据接线照片对照电路图排障,或解读交通地图规划路线。 huggingface.co